SCHEMI DI INTELLIGENZA ARTIFICIALE

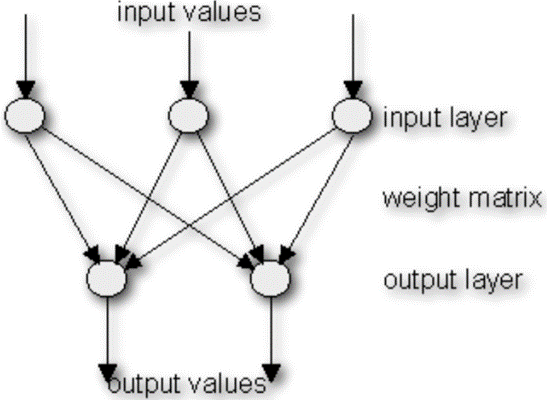

Input Layer: Il livello superiore rappresenta il livello di input, con i nodi che ricevono i valori iniziali (input values).

Weight Matrix: Le connessioni tra i nodi del livello di input e quelli del livello di output rappresentano una matrice di pesi,

che determina l'importanza relativa dei segnali in ingresso.

Output Layer: Il livello inferiore rappresenta il livello di output, dove vengono calcolati i valori finali (output values)

in base agli input e ai pesi.

Questo schema è tipico delle reti neurali feedforward semplici, utilizzate per compiti come classificazione o regressione.

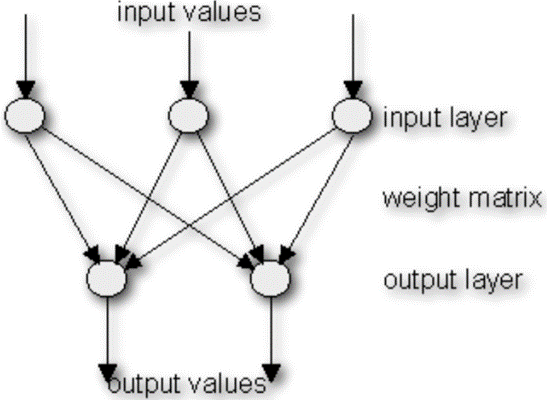

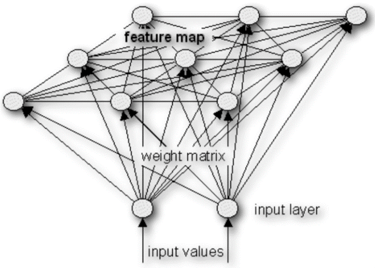

Nodi: Sei nodi disposti a forma di esagono. Ogni nodo rappresenta un neurone.

Connessioni: Ogni nodo è collegato a tutti gli altri, indicando interconnessione completa.

Le linee rappresentano le connessioni sinaptiche tra i neuroni.

Matrice dei Pesi: Al centro, la dicitura "weight matrix" evidenzia che ogni connessione ha un peso associato,

cruciale per l'apprendimento della rete.

Valore di Input: Le frecce esterne con la scritta "input value" mostrano come i dati vengono immessi nella rete

attraverso i nodi.

La funzionalità di questa rete neurale si basa sull'elaborazione di dati attraverso i nodi interconnessi. I passaggi principali sono:

Input: Ogni nodo riceve un valore di input.

Ponderazione: Il valore di input viene moltiplicato per il peso associato a ciascuna connessione.

Aggregazione: I segnali ponderati vengono sommati nel nodo ricevente.

Funzione di Attivazione: Il nodo applica una funzione di attivazione al valore aggregato per determinare l'output del nodo.

Output: L'output del nodo viene propagato ad altri nodi attraverso le connessioni.

La rete apprende regolando i pesi delle connessioni durante la fase di addestramento, permettendo alla rete di svolgere compiti come la classificazione o la regressione.

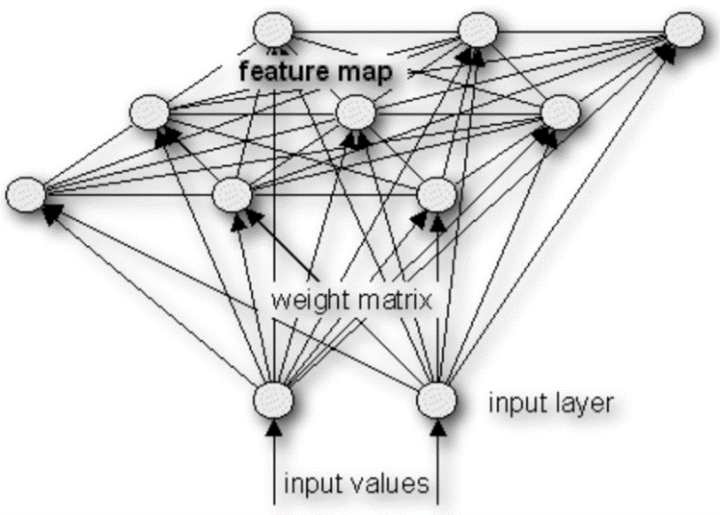

Valori di input: Questi sono i dati grezzi che vengono inseriti nella rete per l'elaborazione.

Strato di input: Questo è il primo livello della rete che riceve i valori di input. Ogni nodo in questo livello rappresenta una singola caratteristica dei dati di input.

Matrice dei pesi: Questa è una raccolta di pesi che vengono utilizzati per moltiplicare i valori di input. I pesi rappresentano la forza della connessione tra i neuroni.

Mappa delle caratteristiche: Questo è l'output della rete. Rappresenta le caratteristiche apprese dai dati di input.

Funzionalmente, questa rete elabora i dati in ingresso passando le informazioni attraverso i livelli, regolando i pesi delle connessioni per apprendere schemi e relazioni. La mappa delle caratteristiche risultante può essere utilizzata per varie attività come la classificazione, la regressione o il riconoscimento di modelli.

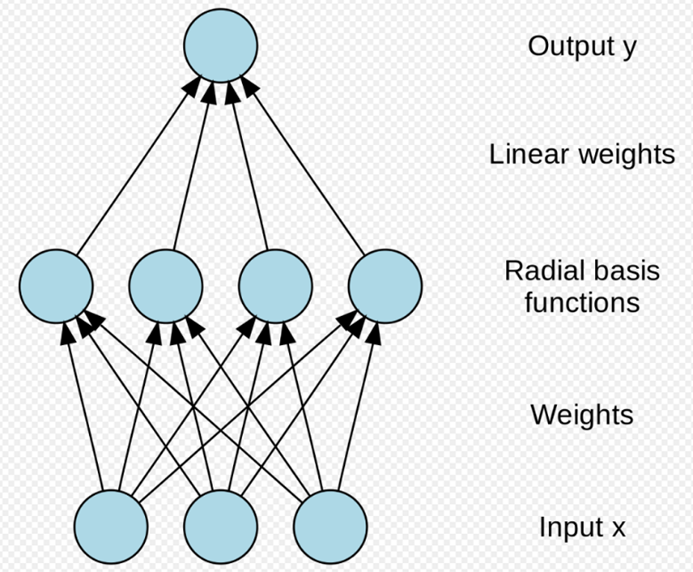

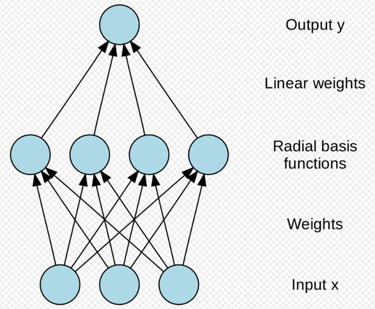

La rete RBF è una rete neurale artificiale che utilizza funzioni a base radiale come funzioni di attivazione.

Come mostrato nell'immagine, la rete RBF tipica ha tre strati:

Strato di input: Riceve i dati di input (x).

Strato nascosto: Applica le funzioni a base radiale. Ogni neurone in questo strato calcola la distanza tra l'input

e il suo centro, e poi applica una funzione RBF (di solito Gaussiana) a questa distanza.

Strato di output: Produce l'output finale (y) attraverso una combinazione lineare delle attivazioni dello strato nascosto.

Approssimazione di Funzioni: Le reti RBF sono utilizzate principalmente per l'approssimazione di funzioni,

la classificazione e la regressione.

Apprendimento: L'addestramento di una rete RBF comporta la determinazione dei centri delle funzioni RBF,

le larghezze (o deviazioni standard) delle funzioni RBF, e i pesi dello strato di output.

Vantaggi: Rispetto ad altre reti neurali, le RBF possono essere addestrate più velocemente e sono meno sensibili

ai problemi di minimi locali.

Svantaggi: Richiedono più neuroni nello strato nascosto rispetto ad altre reti per raggiungere prestazioni simili, specialmente in spazi di input ad alta dimensione.

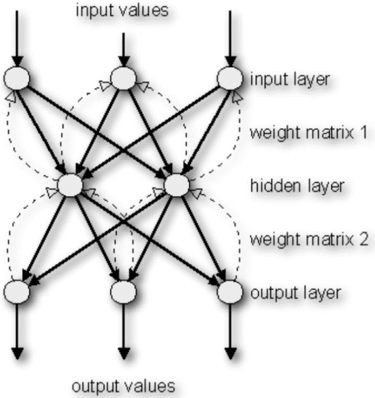

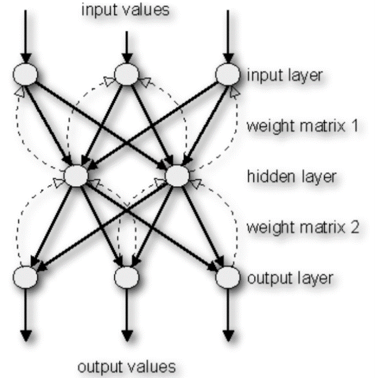

Il diagramma illustra un perceptron multistrato (MLP), una rete neurale artificiale, addestrato con l'algoritmo di backpropagation. Un MLP consiste in almeno tre livelli di nodi: un livello di input, uno o più livelli nascosti e un livello di output. Ogni nodo, o neurone, in un livello è connesso a tutti i nodi nel livello successivo tramite connessioni pesate.

Livello di Input: Riceve i dati di input.

Livello/i Nascosto/i: Esegue computazioni intermedie.

Livello di Output: Produce il risultato della rete.

Le frecce solide nel diagramma rappresentano la direzione del flusso di dati durante il processo di alimentazione in avanti, dove i valori di input vengono propagati attraverso la rete per produrre un output. Le "matrici di peso" indicano i pesi associati alle connessioni tra i livelli, che vengono regolati durante l'addestramento per migliorare la precisione della rete. Le linee tratteggiate rappresentano il processo di backpropagation, dove l'errore tra l'output previsto e quello effettivo viene propagato all'indietro attraverso la rete per aggiornare i pesi.

Gli MLP con backpropagation sono ampiamente utilizzati per vari compiti di apprendimento automatico, tra cui:

Classificazione: Assegnare un input a una categoria predefinita.

Regressione: Prevedere un valore continuo in base all'input.

Riconoscimento di schemi: Identificare modelli o regolarità nei dati.

Approssimazione di funzioni: Approssimare funzioni matematiche sconosciute.

Il processo di addestramento della backpropagation consente all'MLP di apprendere mappature complesse tra input e output, rendendolo uno strumento versatile per la risoluzione di problemi complessi.